La revolución de la inteligencia artificial ha dado un giro sorprendente con la llegada de nuevas aplicaciones que prometen cambiar la forma en que consumimos y creamos contenido. **Sora**, desarrollada por **OpenAI**, y **Vibes**, de **Meta**, han irrumpido en el ecosistema digital ofreciendo herramientas para generar vídeos hiperrealistas que, aunque divertidos, esconden riesgos significativos de desinformación y manipulación.

El auge de Sora y Vibes en la creación de contenido

Ambas aplicaciones están diseñadas para facilitar la creación de vídeos de manera sencilla, recordando a plataformas populares como **TikTok**. Sora, que actualmente se encuentra en fase beta y solo está disponible mediante invitación en **Estados Unidos** y **Canadá**, permite a los usuarios generar contenido que puede ser compartido en un feed similar al de otras redes sociales. Por su parte, Vibes ya está disponible en la aplicación de **Meta AI** y permite la visualización y el intercambio de vídeos creados con inteligencia artificial.

La facilidad de uso y la naturaleza adictiva de estas plataformas han llevado a un aumento del contenido creado con IA, lo que ha suscitado preocupación por la calidad y veracidad de la información que se comparte. La característica más controvertida de Sora es su función «Cameo», que permite a los usuarios crear deepfakes de sí mismos y de figuras públicas, lo que plantea serios dilemas éticos y legales.

Implicaciones sociales y riesgos de desinformación

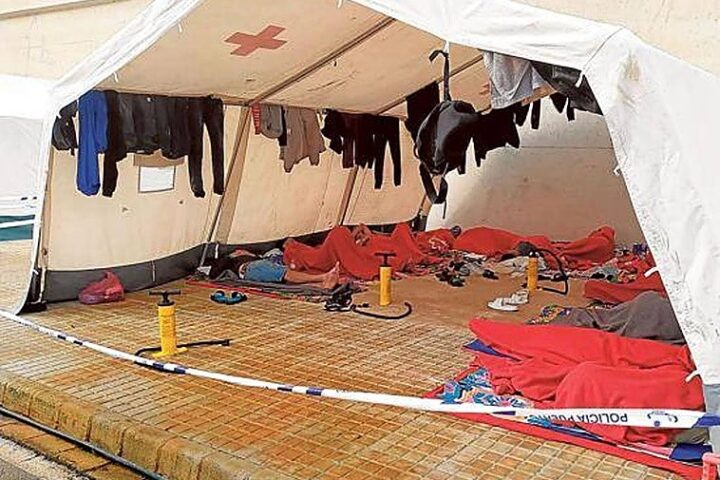

El uso de estas tecnologías ha generado un fenómeno conocido como «mierdificación» de internet, donde la calidad del contenido disminuye y se propagan narrativas dañinas. Un ejemplo alarmante se puede ver en las competiciones que ocurren dentro de Sora, donde se perpetúan estereotipos negativos sobre mujeres, personas inmigrantes y judíos. Estas representaciones, disfrazadas de humor, han comenzado a acumular millones de reproducciones y pueden causar un daño real en la percepción pública de estos colectivos.

A pesar de las afirmaciones de **OpenAI** sobre la moderación de contenido, ya circulan numerosos vídeos de figuras públicas, incluyendo a personas fallecidas, utilizados para desinformar y difamar. **Robin Williams**, por ejemplo, se ha convertido en el blanco de este tipo de contenidos, lo que ha llevado a su hija a solicitar públicamente que se detenga esta práctica.

La proliferación de este tipo de contenido no es algo nuevo; desde el lanzamiento de **Grok**, la IA de **Elon Musk** en **X** (anteriormente Twitter), se han generado imágenes que fomentan el racismo y la xenofobia. Las herramientas como **DALL-E 3** y **Midjourney** también han sido criticadas por reproducir estereotipos nocivos.

La viralización de bulos se ha convertido en un problema creciente, como demuestra el reciente ejemplo de la anciana de “Torenza”, un país ficticio que ha acumulado más de 100 millones de visualizaciones en redes sociales. Aunque inicialmente parece un contenido divertido, contribuye a la desconfianza generalizada en un entorno digital que debería ser informativo.

La llegada de estas herramientas plantea un desafío significativo no solo para los creadores de contenido, sino también para los consumidores, quienes deben ser críticos y cuidadosos con la información que comparten y consumen. La lucha contra la desinformación se intensifica en un mundo donde la tecnología avanza rápidamente y las consecuencias de su uso irresponsable pueden ser devastadoras.